Tu l’as sûrement remarqué. Chaque fois que quelqu’un mentionne ChatGPT à l’université, les conversations basculent aussitôt vers la détection d’IA. On t’explique que Turnitin voit tout, qu’il devine tout, qu’il sent la moindre phrase un peu trop parfaite. On parle de lui comme d’un détecteur surentraîné, prêt à t’attraper au moindre faux pas.

Turnitin peut-il vraiment repérer ChatGPT, ou est-ce un simple mirage numérique ?

La vérité est beaucoup moins spectaculaire, et tellement plus subtile.

Pour comprendre ce que Turnitin voit vraiment, il faut comprendre comment il lit. Oui, lire. Parce que ce logiciel ne se contente pas d’analyser. Il interprète, il soupèse, il fait des hypothèses. Et parfois, il se trompe.

Ce que Turnitin analyse vraiment dans ton texte

Contrairement à ce que beaucoup imaginent, Turnitin ne te compare pas à une base secrète remplie de phrases déjà écrites par ChatGPT. Il ne cherche pas une copie conforme. Ce qu’il piste, c’est un ensemble de caractéristiques d’écriture que les IA ont tendance à répéter.

Il regarde si tes phrases s’enchaînent un peu trop bien. Si la cohérence paraît presque trop régulière. Si ton texte garde le même ton du début à la fin, comme une machine qui ne se fatigue jamais.

Les IA écrivent avec une constance remarquable. Un humain, même excellent, laisse toujours une petite empreinte d’imperfection. Un mot déplacé. Une phrase trop longue. Une respiration inattendue. Turnitin cherche exactement ces moments qui manquent.

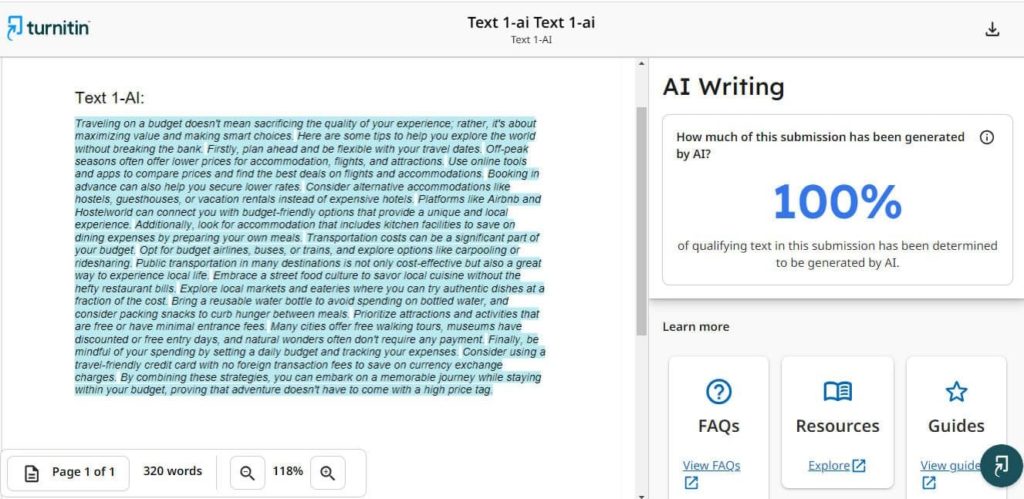

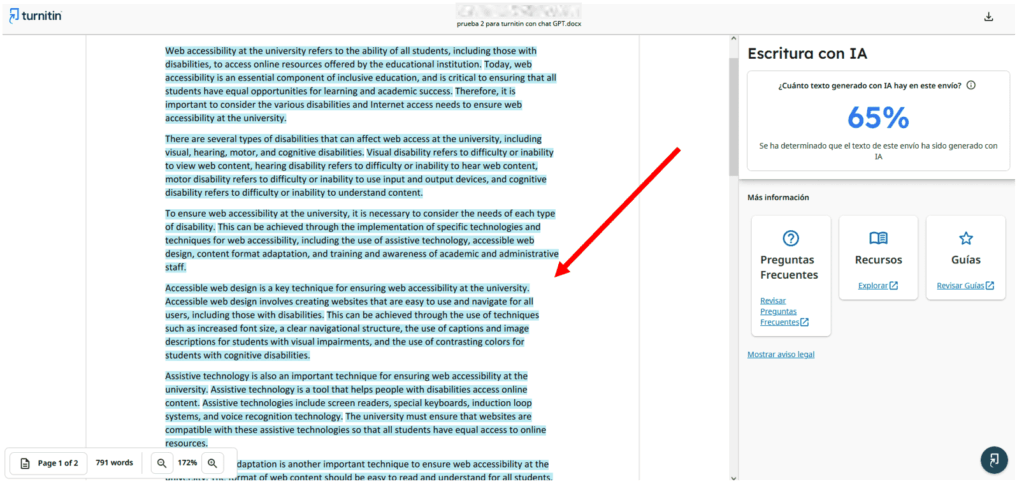

Et pour résumer toute cette analyse, il te donne un score et plus précisément un pourcentage entre 0 et 100 %. Mais attention ! Ce score ne dit pas que ton texte est généré par l’IA. Il dit juste qu’il ressemble à une écriture automatisée.

Il y a même une zone sensible. Lorsque Turnitin détecte entre 1 et 19 %, il ajoute un petit astérisque. Une sorte de « je ne suis pas sûr ». Autrement dit, une zone à haut risque de faux positifs. Tu peux avoir écrit chaque phrase à la main et quand même te retrouver dans cette tranche ambiguë.

Comment lire ce score sans te faire des sueurs froides ?

Quand tu découvres un score IA, tu pourrais croire que Turnitin vient de te juger. En réalité, ce n’est qu’un outil d’estimation. Pas une condamnation. Pas une preuve. Juste une probabilité. Pour t’aider à comprendre ce que ce score signifie, voici quelques repères utiles.

Le score peut monter quand :

- ton style est ultra constant,

- tes phrases semblent trop lissées,

- le texte manque de variation réelle,

- tu écris d’une façon très académique, presque académique au carré.

Également, le score peut baisser quand :

- tu laisses apparaître des imperfections humaines,

- tu changes de cadence ou de structure,

- tu développes une voix personnelle,

- ton raisonnement suit une logique clairement humaine, avec ses nuances.

Turnitin n’a aucune idée de ton effort, de tes brouillons, de tes hésitations.

Il lit juste ce qui est sous ses yeux. Et parfois, ce qui semble trop parfait pour être vrai… est simplement le résultat de ton travail.

Peut-on vraiment paraphraser ChatGPT sans être repéré par Turnitin ?

Tu l’as sûrement déjà entendu. Il suffirait de paraphraser un texte généré par ChatGPT pour passer sous le radar. Comme si changer quelques mots ici et là suffisait à tromper un logiciel entraîné à analyser des millions de phrases. Spoiler : c’est un peu plus compliqué que ça.

La vérité, c’est que Turnitin peut parfois repérer une paraphrase et parfois non. Tout dépend de la manière dont tu reformules, de l’intention que tu mets dans l’écriture et du niveau de transformation réelle que tu donnes au texte. Paraphraser n’est pas un bouton magique. C’est un acte d’écriture. Et Turnitin reconnaît parfois très bien la différence.

Quand la paraphrase est trop légère

Avant de plonger dans les détails, on pose le décor. Une paraphrase légère, c’est une phrase où tu changes quelques mots mais tu gardes la même structure, la même logique, la même respiration. Un peu comme si tu posais un filtre différent sur la même photo.

Le problème, c’est que les modèles de langage ont une manière très particulière de structurer les idées. Leur organisation interne revient dans presque toutes leurs réponses. Si tu modifies simplement quelques verbes ou adjectifs, Turnitin reconnaîtra le squelette du texte.

Dans ce cas, il peut signaler que la phrase semble avoir été « générée puis reformulée ». Le système ne se laisse pas impressionner par quelques synonymes. Il analyse le rythme, le cheminement, la structure mentale de la phrase.

Et c’est souvent là que les étudiants se font piéger. Parce que tu peux penser avoir tout changé, alors que l’essentiel, la structure invisible, est resté intact.

Quand la réécriture devient vraiment profonde

À l’inverse, il existe des situations où Turnitin a beaucoup plus de mal. C’est le cas lorsque tu reprends un texte généré par une IA et que tu le réécris vraiment.

Cela arrive quand tu reformules le raisonnement, que tu introduis ta propre manière d’avancer d’une idée à l’autre, que tu modifies l’angle des phrases, leur ton, leur tempo. À ce moment-là, ce n’est plus une paraphrase mécanique. C’est ton écriture.

Et là, Turnitin n’a plus grand-chose à comparer. Le texte prend une respiration humaine, plus mouvante, plus irrégulière. Les IA créent des lignes droites. Les humains dessinent des courbes.

C’est pour ça que certaines réécritures passent totalement inaperçues, même si l’idée de départ venait d’un modèle de langage. Turnitin ne lit pas tes intentions. Il lit uniquement ce que ton texte semble être. Et un texte profondément retravaillé ressemble presque toujours à un texte humain.

Comment Turnitin détecte-t-il ChatGPT quand tu soumets ton texte ?

Tu t’imagines peut-être Turnitin comme un scanner futuriste qui balaie ton document d’un seul regard. En réalité, ce qu’il fait est beaucoup plus méthodique. Plus discret aussi. Il ne lit pas ton texte comme toi. Il ne se laisse pas porter par l’argumentation, ni par les nuances, il découpe, il trie, il classe et transforme ton écriture en une série de motifs, comme s’il cherchait des empreintes dans le sable.

Le « texte qualifiant » que Turnitin surveille de près

Avant de comprendre comment Turnitin découpe un texte, il faut comprendre ce qu’il choisit d’étudier. Le logiciel n’analyse pas chaque élément de ton document. Il laisse passer ce qu’il considère comme non significatif pour détecter un style. Il ignore donc :

- les listes ;

- les tableaux ;

- les blocs de code ;

- les citations figées ;

- les zones mises en forme mécaniquement ;

- les éléments qui ne reflètent pas réellement ta manière d’écrire.

Ce qui l’intéresse vraiment, c’est ta prose continue, celle où tu t’exprimes, où tu expliques, où tu développes. C’est dans ces paragraphes que Turnitin peut repérer les traces d’une écriture automatisée ou, au contraire, les imperfections naturelles d’un humain.

Pourquoi ce choix très sélectif ? Parce que plus un texte est continu, plus il laisse émerger une signature stylistique. Et c’est exactement ce que cherche Turnitin.

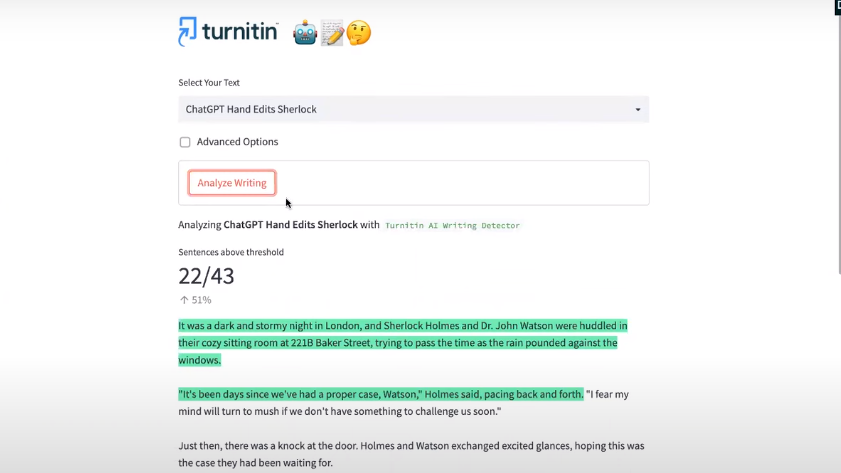

Comment Turnitin découpe ton texte pour l’examiner

Une fois qu’il a identifié ce qu’il considère comme un texte exploitable, Turnitin le découpe en segments. Ce sont de petites unités d’analyse, séparées les unes des autres. Chacun de ces segments est étudié indépendamment, comme si le logiciel prenait des instantanés successifs de ton écriture.

À chaque segment, il observe :

- la régularité des phrases ;

- la cohérence interne ;

- la variation du style ;

- les structures répétitives ;

- l’éventuelle fluidité “trop parfaite”.

Chaque portion reçoit ensuite une estimation. Et ce n’est qu’en regroupant toutes ces estimations que Turnitin génère le fameux score IA. Le logiciel n’évalue donc pas ton texte comme une seule entité, mais comme un ensemble de micro-échantillons.

Cette logique explique pourquoi :

- un texte totalement humain peut contenir une zone signalée ;

- un texte partiellement généré peut parfois passer sans alerte ;

- un passage retravaillé par un humain peut effacer toute trace d’IA ;

- un segment trop lisse peut attirer l’attention, même s’il est authentique.

Turnitin ne se comporte pas comme un lecteur qui suit le fil de ta pensée. Il agit plutôt comme un analyste statistique qui scrute les régularités de ton écriture, un peu comme si ton texte était un ensemble d’empreintes que l’on examine au microscope. Il ne s’intéresse ni à ton intention ni à ta logique interne, seulement aux motifs que tu laisses derrière toi. Certains ressemblent à des choix très humains, d’autres évoquent davantage les automatismes d’une IA. Et parfois, la frontière entre les deux devient suffisamment fine pour que le logiciel hésite.

A lire aussi >>> Comment fonctionne la limite par jour de ChatGPT ?

Le logiciel de détection par IA de Turnitin est-il vraiment fiable ?

Tu as probablement déjà vu passer des témoignages d’étudiants convaincus que Turnitin « invente » parfois des détections. Et honnêtement, ils n’ont pas complètement tort. Le logiciel peut signaler un texte généré par ChatGPT, mais aussi se tromper sur un texte parfaitement humain. Une fiabilité annoncée ne garantit pas une réalité infaillible. Et quand il s’agit d’un outil qui peut influencer l’évaluation académique, chaque nuance compte.

La question n’est pas seulement de savoir si Turnitin détecte l’IA. La vraie question est de savoir avec quelle précision il le fait.

La limite d’une détection fondée sur la perplexité et la rafale

Avant de comprendre pourquoi Turnitin peut se tromper, il faut comprendre ce qu’il mesure. Son système repose principalement sur deux notions issues de la linguistique computationnelle. La perplexité et la rafale. Ces deux indicateurs lui permettent d’évaluer à quel point un texte semble « naturel », dans le sens statistique du terme.

Pour que ce soit clair :

- La perplexité estime la prévisibilité d’un passage.

- La rafale mesure la variation dans la longueur et la construction des phrases.

Les modèles de langage produisent souvent des phrases très régulières, très prévisibles. Un peu trop parfois. Les humains, eux, alternent entre formulations fluides et moments plus hésitants, avec des variations qui reflètent un cheminement intellectuel. Lorsque Turnitin repère une écriture trop régulière, il la classe dans la zone suspecte.

Le problème, c’est que l’écriture académique possède exactement ces caractéristiques. Elle est cohérente, structurée, méthodique. Bref, elle ressemble déjà beaucoup à un texte généré par une IA. Et c’est là que les erreurs commencent.

Les faux positifs, un risque beaucoup plus courant qu’on l’imagine

Si tu te demandes pourquoi tant d’étudiants se plaignent d’être signalés alors qu’ils n’ont utilisé aucune IA, la réponse est simple. Les faux positifs sont réels. Et ils ne sont pas rares.

Parmi les situations où Turnitin se trompe souvent, on retrouve :

- les étudiants dont la langue maternelle n’est pas celle du devoir ;

- les rédacteurs au style très académique ;

- les textes franchement structurés ou très propres ;

- les dissertations construites selon un modèle rigoureux ;

- les passages où l’auteur concentre plusieurs idées similaires.

Certaines universités ont même observé que des documents écrits des années avant l’existence de ChatGPT apparaissaient comme suspects lorsqu’ils étaient analysés aujourd’hui. La machine ne comprend pas le contexte historique. Elle ne comprend pas le style personnel. Elle n’analyse que des modèles.

Pour un étudiant, se retrouver avec un score IA élevé alors qu’il n’a rien fait d’autre qu’écrire correctement peut être déstabilisant. Mais c’est un scénario assez fréquent. Et c’est la raison pour laquelle le score IA ne devrait jamais être utilisé comme unique preuve de fraude.

Les textes hybrides que Turnitin évalue très mal

Il existe un autre point sensible dont on parle moins souvent.

Le cas des textes hybrides. Quand un devoir mélange écriture humaine et améliorations ponctuelles faites par une IA, Turnitin peut perdre complètement ses repères.

Les études montrent que, dans ces contextes, les scores générés par le logiciel sont souvent incohérents. Un passage intégralement généré par IA peut passer inaperçu, tandis qu’un passage authentique peut être signalé. Il n’existe alors aucune corrélation fiable entre ce que Turnitin détecte et ce qui a réellement été écrit par une IA.

C’est un peu comme analyser deux voix qui chantent ensemble.

Si elles se superposent trop bien, il devient difficile de distinguer qui chante quoi.

La détection IA peut indiquer une tendance, mais elle n’apporte pas une vérité.

A lire aussi >>> Pourquoi ChatGPT 5 est lent dans les longues conversations ?

Accusation injustifiée : comment réagir si ton texte humain est signalé comme généré par une IA ?

C’est le scénario que redoutent tous les étudiants. Tu écris ton devoir à la main, tu t’appliques, tu y passes du temps, et quand tu le soumets, Turnitin t’annonce qu’il détecte une part d’IA. L’effet est immédiat. Une bouffée d’incompréhension, parfois de panique, et ce sentiment étrange d’être accusé à tort.

Respire.

Parce qu’un score IA n’est pas une condamnation.

Et parce que oui, il existe une manière claire, posée et efficace de rétablir la réalité.

Avant tout, rappelle-toi une vérité souvent ignorée.

Les faux positifs existent.

Ils ne sont pas une exception, ils sont une possibilité réelle. Les universités commencent d’ailleurs à reconnaître qu’un score IA, seul, n’est pas une preuve.

Voyons maintenant comment reprendre la main si ça t’arrive.

Rassemble tes preuves comme un auteur qui remonte le fil

Quand un texte est signalé à tort, la première chose à faire est de montrer que tu es bien l’auteur. Pas avec des déclarations, mais avec des éléments concrets. Tout ce qui atteste de ton processus d’écriture est utile.

Tu peux présenter :

- tes brouillons manuscrits ;

- les versions enregistrées automatiquement par Google Docs ou Word ;

- les fichiers intermédiaires ;

- les traces de corrections successives ;

- les notes, recherches, références que tu as utilisées ;

- les captures d’écran de ton travail au fil des jours.

Tu ne prouves pas seulement que tu as écrit.

Tu montres comment tu as écrit.

Et ça, aucune IA ne peut le reproduire.

Relis ton texte comme un enseignant le ferait

Avant de discuter avec ton professeur, relis ton devoir avec un œil neuf.

Demande-toi si certains passages sont trop lisses, trop uniformes, trop proches du style des modèles de langage. Pas pour les supprimer, mais pour comprendre pourquoi Turnitin a pu les interpréter ainsi.

Si tu identifies un paragraphe qui semble trop régulier, tu peux l’ajuster légèrement pour qu’il reflète davantage ton rythme naturel. Une nuance, une reformulation, un changement d’enchaînement. Parfois, cela suffit à lever le doute.

Cette étape te permet aussi de te sentir plus confiant dans l’échange qui suit.

Demande une évaluation humaine, pas un verdict automatisé

La plupart des enseignants savent que Turnitin n’est pas infaillible. Et beaucoup préfèrent fonder leur jugement sur ta logique, ton style, ton niveau habituel, plutôt que sur un score algorithmique.

Explique calmement ta situation. Présente ton processus. Et propose une relecture humaine du passage signalé.

Un professeur expérimenté repère immédiatement :

- si ton raisonnement est cohérent ;

- si l’écriture reflète ta manière habituelle ;

- si la progression de tes idées est authentique.

En bref, ce qu’une IA ne peut pas imiter.

Et surtout, ce qu’un logiciel ne peut pas analyser.

Personne ne devrait être jugé uniquement sur un score automatisé.

Et dans les faits, les enseignants raisonnables ne le font pas.

Pour conclure…

L’arrivée de l’IA dans l’écriture académique a changé beaucoup de choses. Elle a rendu les étudiants plus prudents, les enseignants plus vigilants, et les logiciels comme Turnitin plus présents que jamais dans le paysage universitaire.

Mais malgré son rôle important, Turnitin ne possède pas une vision absolue de la vérité. Il ne lit pas comme un humain. Il ne comprend pas l’intention. Il mesure des motifs, des régularités, des tendances. Et parfois, ces tendances ressemblent à celles de ChatGPT alors qu’elles ne sont qu’une manière naturelle d’écrire.

Tu peux retenir ceci.

Turnitin peut détecter certains textes générés par l’IA, mais il peut aussi se tromper. Il peut confondre l’écriture humaine avec celle d’un modèle. Il peut mal interpréter un style académique strict. Et il peut complètement perdre pied avec les textes hybrides.

C’est pour cette raison qu’un score IA ne doit jamais être considéré comme une preuve, mais comme un indice, une invitation à vérifier, un début de conversation.

L’intégrité académique repose sur ce qu’un étudiant produit, mais aussi sur sa façon de réfléchir. Et ça, aucune IA ne peut le remplacer.

Ni Turnitin.

Ni ChatGPT.

Ni aucun autre outil.

Tu restes l’auteur.

Et c’est ça qui compte le plus.